Perbincangan mengenai etika kecerdasan buatan kembali memanas di platform X setelah muncul laporan tentang penyalahgunaan fitur AI Grok untuk memanipulasi foto perempuan tanpa izin.

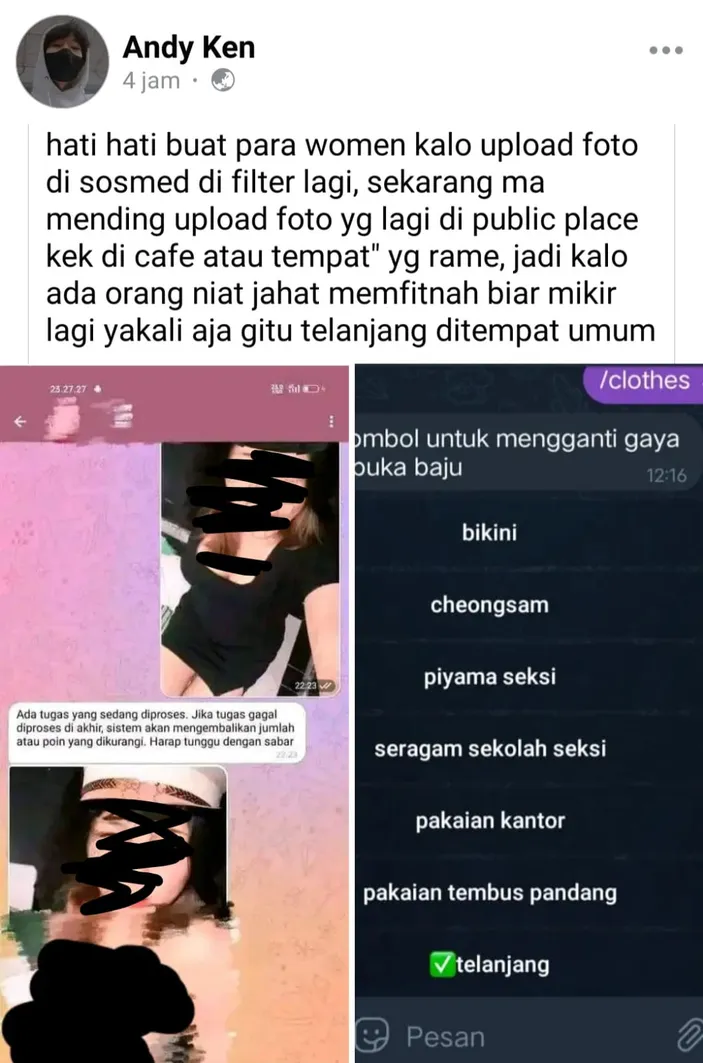

Praktik ini dilakukan dengan cara mengubah gambar yang awalnya menampilkan perempuan berpakaian sopan menjadi seolah-olah mengenakan pakaian minim atau bahkan menghilangkan atribut tertentu, lalu menyebarkannya di media sosial.

Fenomena tersebut memicu kemarahan warganet sekaligus membuka kembali diskusi serius soal perlindungan korban, etika teknologi, dan kekerasan berbasis gender online (KBGO).

Sejumlah tangkapan layar yang beredar luas di X menunjukkan bagaimana pengguna memanfaatkan Grok—chatbot AI yang terintegrasi langsung dengan platform tersebut—untuk mengedit foto perempuan.

Dalam beberapa kasus, foto perempuan berhijab diubah menjadi tidak berhijab, sementara pada kasus lain, foto berpakaian tertutup dimanipulasi sehingga tampak mengenakan bikini atau pakaian terbuka.

Salah satu pengguna X dengan akun @nd** mengkritik keras tren tersebut dan menyebutnya sebagai tindakan yang bermasalah secara moral dan sosial.

“Akhir-akhir ini aku sering melihat orang meminta AI Grok mengedit foto perempuan seperti ini, misalnya jadi pakai bikini. Kalau pemilik foto merasa tidak nyaman, ini jelas sudah masuk kekerasan berbasis gender yang difasilitasi teknologi, atau KBGO,” tulisnya pada Selasa, 30 Desember 2025.

Kecaman serupa datang dari pengguna lain, @shylver****, yang membagikan tangkapan layar manipulasi foto perempuan berhijab.

Ada juga thread yang datang dari akun @ele**** di X yang merespons maraknya tren buruk tersebut.

“Guys please stop ngambil foto orang lain (terutama perempuan) tanpa izin, lalu edit pakai Grok jadi versi ‘lucu’ atau memalukan buat bahan bercandaan? Itu bukan joke, itu pelecehan,” ucapnya pada Jumat, 2 Januari 2026.

Unggahan itu memperlihatkan betapa mudahnya teknologi AI digunakan untuk mengubah identitas visual seseorang, tanpa mempertimbangkan dampak psikologis maupun sosial terhadap korban.

Isu ini ternyata tidak hanya terjadi di Indonesia. Media Straight Arrow News pada Mei lalu melaporkan bahwa Grok menuai kritik di sejumlah negara setelah diketahui dapat dimanfaatkan untuk mengedit foto perempuan menjadi tampilan tanpa busana.

Kekhawatiran semakin meluas ketika seorang perempuan di X mendemonstrasikan bagaimana pengguna cukup membalas unggahan foto perempuan lalu meminta Grok mengubahnya menjadi konten bermuatan pornografi.

Kasus tersebut kemudian menarik perhatian media teknologi seperti 404 Media. Walau manipulasi gambar tanpa persetujuan bukan hal baru di era digital, kehadiran layanan AI yang mudah diakses publik dinilai memperbesar potensi penyalahgunaan.

Grok sendiri dikembangkan oleh xAI, perusahaan kecerdasan buatan yang terafiliasi dengan Elon Musk. Secara resmi, xAI memiliki Aturan Penggunaan yang secara tegas melarang pemanfaatan AI untuk merugikan individu.

Dalam xAI Acceptable Use Policy (AUP) yang mulai berlaku pada 2 Januari 2025, disebutkan bahwa pengguna dilarang menggunakan Grok maupun hasil keluarannya untuk kegiatan ilegal atau berbahaya.

Larangan tersebut mencakup pelanggaran privasi, penggambaran rupa seseorang dalam konten pornografi, seksualisasi individu, hingga aktivitas penipuan, pelecehan, penguntitan, peretasan, dan doxing.

xAI juga menegaskan prinsip “do not harm people”, yang berarti AI tidak boleh digunakan untuk merugikan orang lain atau mengambil tindakan tanpa izin atas nama pihak lain.

Meski aturan itu sudah jelas, hingga kini pihak X belum memberikan pernyataan resmi terkait kontroversi penyalahgunaan Grok.

Elon Musk sendiri sebelumnya memuji Grok sebagai AI yang “based”, istilah slang yang merujuk pada sikap autentik dan berani berbeda dibandingkan chatbot pesaing.

Bagaimana Aturan AI di Indonesia?

Di Indonesia, persoalan deepfake dan manipulasi AI juga menjadi perhatian pemerintah. Dikutip dari siaran pers pada situs Kementerian Komunikasi dan Digital, Wakil Menteri Komunikasi dan Digital (Komdigi) Nezar Patria mengungkapkan bahwa peredaran video deepfake meningkat hingga 550 persen dalam lima tahun terakhir, berdasarkan data Sensity AI.

“Saya yakin jumlahnya sebenarnya jauh lebih besar, karena kemampuan aplikasi untuk membuat foto dan video deepfake sekarang sudah sangat masif,” ujar Nezar dalam Talkshow Bentara Nusantara bertajuk Urun Daya Tangkal Hoax dan Deepfake AI pada September 2025.

Nezar mendorong platform digital global seperti Google dan TikTok untuk menyediakan fitur pendeteksi konten AI guna membantu masyarakat melawan hoaks dan deepfake.

Saat ini, Komdigi tengah menyiapkan dua regulasi utama terkait kecerdasan buatan, yakni Peta Jalan AI dan Peraturan Presiden tentang tata kelola keselamatan serta keamanan penggunaan AI.

Ia menegaskan bahwa Indonesia sebenarnya telah memiliki payung hukum seperti UU ITE, UU Perlindungan Data Pribadi, PP Tunas, serta berbagai aturan teknis lainnya. Namun, pemerintah menilai perlu ada regulasi khusus yang memastikan pemanfaatan AI berjalan secara etis, bertanggung jawab, dan bermanfaat bagi publik.

Sebelumnya, Kementerian Kominfo juga telah menerbitkan Surat Edaran Menteri Kominfo Nomor 9 Tahun 2023 tentang Etika Kecerdasan Artifisial. Aturan ini menekankan prinsip kemanusiaan, perlindungan data pribadi, inklusivitas, transparansi, serta akuntabilitas.

Melalui kebijakan tersebut, pelaku usaha dan penyelenggara sistem elektronik diwajibkan memiliki pedoman internal serta melakukan pengawasan ketat agar teknologi AI tidak disalahgunakan dan tidak merugikan masyarakat.***